Der Schwarm-Paradox: Wenn Roboter sich selbst im Weg stehen

Warum zu viele Roboter die Arbeit bremsen: Forschende aus Harvard lösen das Schwarm-Paradox durch gezielten Zufall. Effizienz durch „Rauschen“.

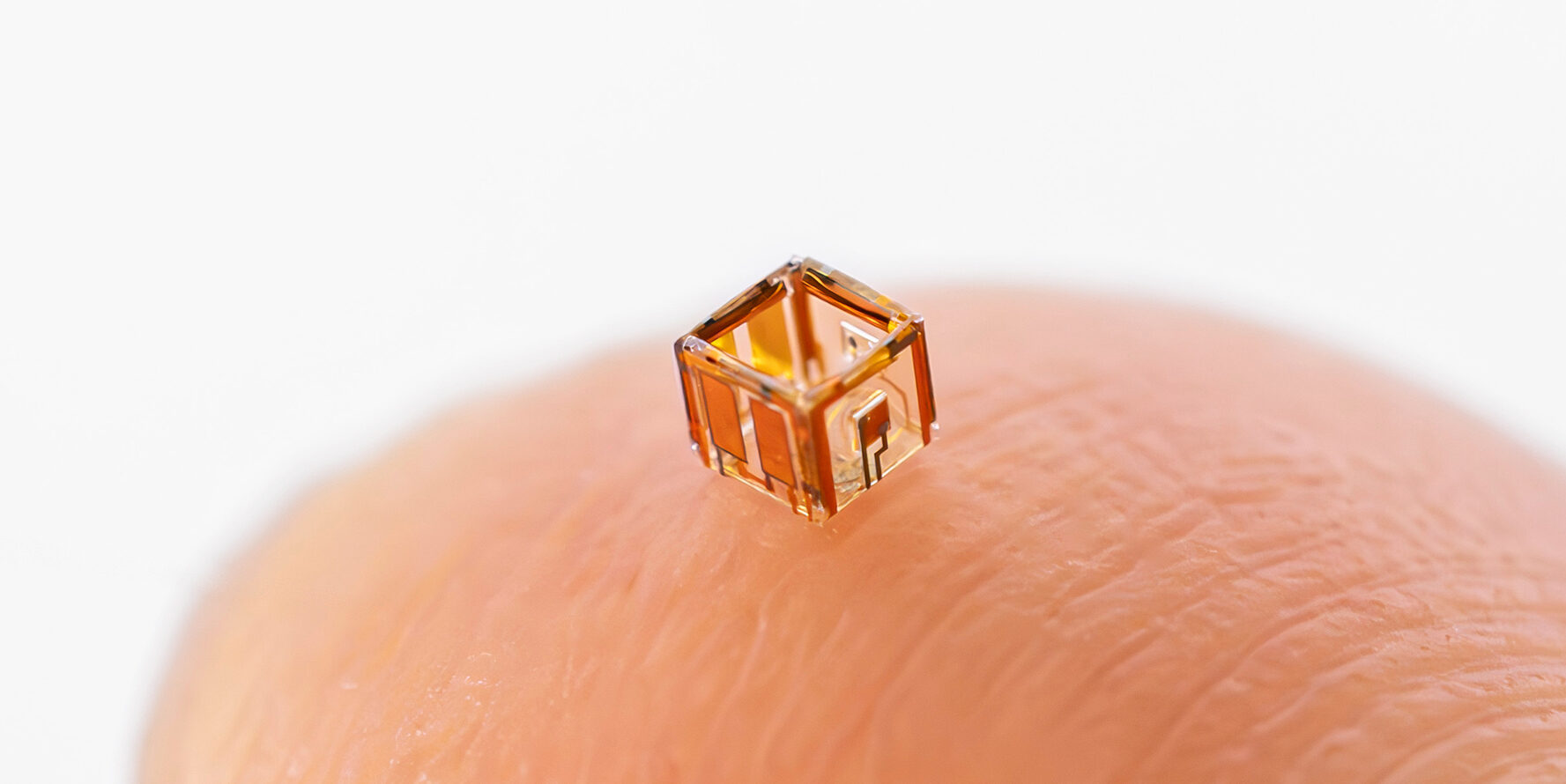

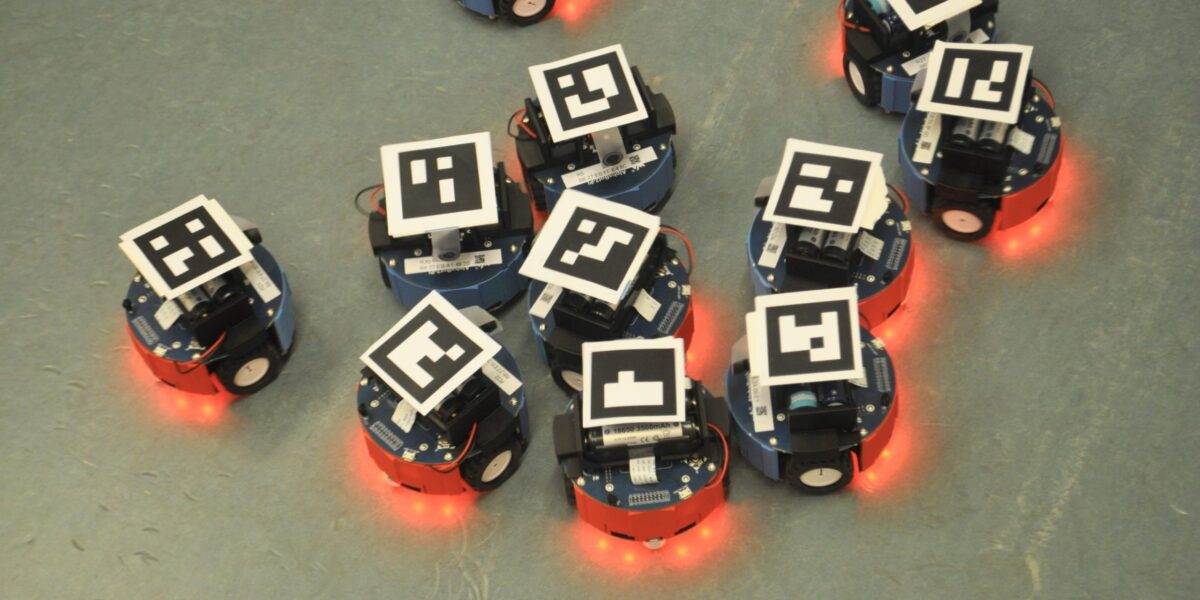

Gezieltes Chaos im Labor: Die kleinen Radroboter im Experiment der Harvard-Forschenden nutzen bewusste Abweichungen in ihren Fahrwegen, um Staus in dichten Schwärmen zu vermeiden.

Foto: Lucy Liu / Harvard SEAS

Forschende aus Harvard haben untersucht, wie Roboterschwärme in engen Umgebungen effizienter arbeiten können. Das Ergebnis: Zu viel Zielstrebigkeit führt zu massiven Blockaden. Erst durch die Zugabe von gezielter Zufälligkeit in den Bewegungsabläufen – sogenanntem Rauschen – lösen sich Staus auf. Diese mathematisch berechenbare „Goldilocks-Zone“ ermöglicht maximale Produktivität ohne teure Zentralsteuerung.

Inhaltsverzeichnis

Zu viele Roboter verderben den Brei

Stellen Sie sich eine Katastrophenlage vor. Ein Öltanker ist verunglückt, die Zeit drängt. Ein Schwarm winziger Roboter soll die Verschmutzung beseitigen. Die Logik diktiert: Je mehr Maschinen wir einsetzen, desto schneller ist die Arbeit erledigt. Doch in der Welt der Robotik gilt dieser Grundsatz nur bis zu einem gewissen Punkt. Danach kippt die Effizienz. Die Maschinen behindern sich gegenseitig, verkeilen sich und die Mission stagniert.

Dieses Phänomen bezeichnen Fachleute oft als das „Zu-viele-Köche-Problem“. In begrenzten Räumen führt eine hohe Dichte an Akteuren zwangsläufig zu Chaos. Angewandte Mathematikerinnen und Mathematiker der Harvard University haben nun eine Lösung gefunden, die auf den ersten Blick paradox klingt: Um Ordnung zu schaffen, braucht es eine kontrollierte Portion Zufall.

Wenn Präzision zum Hindernis wird

In einer Studie, die im Fachmagazin Proceedings of the National Academy of Sciences erschien, untersuchte ein Team unter der Leitung von Lucy Liu die Dynamik in überfüllten Umgebungen. Das Problem bei herkömmlichen Systemen: Roboter agieren oft zu zielstrebig. Bewegen sich alle Agenten auf direktem Weg zu ihrem Ziel, bilden sich dichte Staus.

Die Forschenden nutzten für ihre Analyse das Konzept der Zufälligkeit. Anstatt jeden Weg minutiös zu planen, behandelten sie die einzelnen Roboter als einfache Akteure mit einem einstellbaren Maß an „Schwankung“.

Lucy Liu erklärt dazu: „Das mag kontraintuitiv erscheinen, denn wie könnte Zufälligkeit die Arbeit erleichtern? Aber in diesem Fall, wenn man viel Zufälligkeit hat, wird es möglich, Durchschnittswerte zu bilden – durchschnittliche Entfernungen, durchschnittliche Zeiten, durchschnittliche Verhaltensweisen. Das macht es viel einfacher, Vorhersagen zu treffen.“

Die Suche nach der „Goldilocks-Zone“

Um diese Theorie zu belegen, simulierte das Team Flotten von Agenten. Diese starteten an beliebigen Positionen und erhielten ständig neue Ziele. Dabei variierten die Fachleute das sogenannte „Rauschen“ – also die Abweichung von der direkten Ideallinie.

Die Ergebnisse der Simulationen waren eindeutig:

- Null Rauschen: Die Agenten marschierten stur geradeaus und verursachten sofort massive Blockaden.

- Hohes Rauschen: Die Staus lösten sich auf, doch die Roboter zickzackten so ziellos umher, dass sie kaum Fortschritte machten.

- Die Ideallösung: Eine mittlere Intensität an Zufälligkeit ließ die Roboter zwar kurz aneinanderstoßen, ermöglichte es ihnen aber, geschmeidig aneinander vorbeizugleiten.

Diese optimale Mischung sorgt dafür, dass der Fluss in Bewegung bleibt. Das Team entwickelte daraus mathematische Formeln, um die optimale Dichte und das nötige Rauschen für maximale Durchsatzraten zu berechnen.

Vom Computer in die reale Werkstatt

Theorie ist gut, Praxis ist besser. Gemeinsam mit Federico Toschi von der Technischen Universität Eindhoven testete Liu die Formeln an echten, radgetriebenen Robotern. In einem speziellen Labor überwachte eine Kamera die Positionen der Maschinen via QR-Codes.

Obwohl die physischen Roboter sich weniger präzise bewegten als ihre digitalen Ebenbilder, bestätigte sich das Prinzip. Die wichtigste Erkenntnis für die Ingenieurpraxis: Es braucht keinen sündhaft teuren Zentralrechner oder „superintelligente“ Maschinen. Einfache, lokale Regeln reichen völlig aus, um komplexe Aufgaben in einer Gruppe zu koordinieren.

L. Mahadevan, Professor für Angewandte Mathematik in Harvard, sieht darin ein universelles Prinzip: „Zu verstehen, wie aktive Materie – sei es ein Ameisenschwarm, eine Tierherde oder eine Gruppe von Robotern – unter Anwendung der Prinzipien der Selbstorganisation in überfüllten Umgebungen funktionsfähig wird […], ist für viele Fragen der Verhaltensökologie relevant. Unsere Studie legt Strategien nahe, die durchaus weit über die von uns untersuchte Instanz hinausgehen könnten.“

Ein Beitrag von: