Fraunhofer entwickelt erstes Prüfsystem für selbstfahrende Autos

Autos müssen Sicherheitsstandards erfüllen, Autofahrerinnen und -fahrer Verkehrsregeln beachten und auf Situationen adäquat reagieren. Damit autonom fahrende Fahrzeuge darauf nicht nur trainiert, sondern die Ergebnisse auch getestet werden können, haben Forschende das erste Prüfsystem entwickelt.

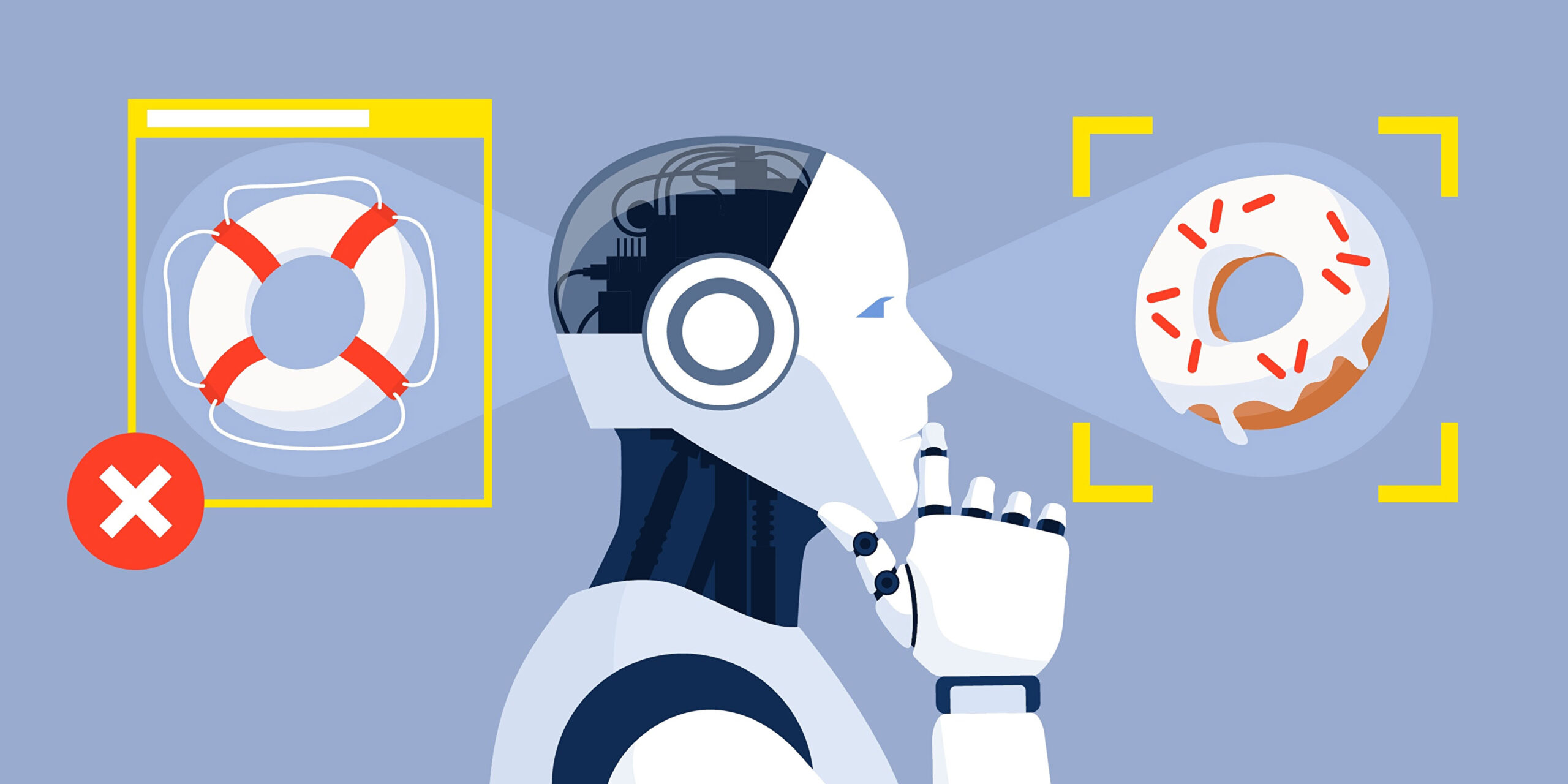

![Das neu entwickelte System kann Körperhaltungen und bestimmte Objekte erkennen sowie daraus auf Aktivitäten der Insassen schließen.

Foto: Fraunhofer IOSB / M. Zentsch [M]](https://www.ingenieur.de/wp-content/uploads/2023/07/Fraunhofer-entwickelt-erstes-Pruefsystem-fuer-autonome-Autos-scaled-e1689170745588-980x490.jpg)

Das neu entwickelte System kann Körperhaltungen und bestimmte Objekte erkennen sowie daraus auf Aktivitäten der Insassen schließen.

Foto: Fraunhofer IOSB / M. Zentsch [M]

Wer schon einmal sein Auto durch den dichten Feierabendverkehr sicher nach Hause gesteuert hat, weiß sehr genau, worauf zu achten ist: andere Verkehrsteilnehmende, Ampeln, Kreuzungen, Verkehrsregeln – es gilt eine Vielzahl an Informationen zu verarbeiten, Regeln zu beachten und adäquat darauf zu reagieren. Schließlich wollen Sie sicher zu Hause ankommen und nicht in einen Unfall verwickelt werden. Damit autonom fahrende Autos diese Szenarien künftig selbstständig bewältigen und die Aufgaben einer Fahrerin oder eines Fahrers sicher übernehmen können, sind nicht nur entsprechende Trainingsdaten dafür von besonderer Bedeutung, sondern auch möglichst realitätsnahe Testumgebungen. Schließlich müssen Entwicklerinnen und Entwickler in der Lage sein, ihre Arbeit zu überprüfen und nicht nur in Simulationen, sondern zusätzlich im realen Verkehrsgeschehen testen, ob sich die Autos den Erwartungen entsprechend verhalten.

Mercedes-Benz erhält erste Zulassung für Level 3 des autonomen Fahrens in USA

Das Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung (IOSB) hat in Kooperation mit dem Fraunhofer-Institut für Arbeitswirtschaft und Organisation (IAO), der Universität Stuttgart, der IPG Automotive GmbH, die sich mit Simulationslösungen beschäftigen, und der auf KI-Anwendungen spezialisierten EDI GmbH genau solche realistischen und spezifischen Prüfszenarien entwickelt. Entstanden sind sie im Rahmen des Projekts RELAI (Risk Estimation with a Learning AI) – gefördert vom Bundesministerium für Digitales und Verkehr (BMDV).

Erstes Prüfsystem für autonome Autos beinhaltet auch Fußgängersimulator

Im Rahmen des Projekts legten die Partner ihr Augenmerk vor allem auf Fußgänger und Radfahrer. Denn gerade deren Reaktion in kritischen Situationen müssen autonome Fahrzeuge besonders gut einschätzen können. Zur Überprüfung haben die Partner eine virtuelle Testumgebung mit einem VR-Fußgängersimulator sowie einem Katalog an unterschiedlichsten Prüfszenarien entwickelt. Der Vorteil daran: Das System dient nicht nur der Überprüfung, sondern kann auch bei Entwicklung und Training unterstützen.

Konkret funktioniert der Simulator über eine Weblösung. Das sogenannte KI-basierte Tool-Chain ist zur automatischen Identifizierung, Evaluierung und Formalisierung kritischer Verkehrssituationen gedacht. Die dafür notwendige Cloud-Plattform inklusive des IoT Framework kommt von der EDI GmbH. Ein spezieller Algorithmus mit Namen Dynamic Risk Management (DRM) beinhaltet mehr als 100.000 Datensätze kritischer Verkehrssituationen aus Japan sowie öffentlichen Datensätzen der Firma Waymo. Die Expertinnen und Experten der EDI GmbH fügten manuell noch Daten aus dem Testfeld Autonomes Fahren Baden-Württemberg hinzu. Vom Fraunhofer IOSB kamen Informationen zum Verhalten von Fußgängerinnen und Fußgängern sowie zur Anonymisierung. Auf diese Art und Weise entstand eine KI, die Fahrsituationen genau erkennt und auswertet.

Bilder aus dem Innenraum helfen autonomen Autos

In naher Zukunft wird es auf den Straßen vor allem sogenannten Misch-Verkehr geben. Das bedeutet: Es werden Fahrzeuge unterwegs sein, die mit Assistenzsystemen ausgestattet sind, neben Autos, die bereits autonom fahren können. In einem solchen Fall ist es für das Fahrzeug besonders wichtig zu wissen, was im Innenraum geschieht. Nur wenn das Auto in der Lage ist, dies sicher zu erkennen, kann die Interaktion zwischen Fahrzeug und Fahrerin oder Fahrer auch gut funktionieren. Deshalb war das sogenannte Advanced Occupant Monitoring System des Fraunhofer IOSB eine wichtige Komponente innerhalb des RELAI-Projekts. Das System bietet eine kamerabasierte Aktivitätserkennung und kann daraus ableitend die Aktivitäten der Passagiere im Innenraum interpretieren. Alles völlig datenschutzkonform.

Dank optischer Sensoren kann das System zahlreiche unterschiedliche Bewegungen, Gesten und Körperhaltungen erkennen. Dafür werden alle Personen im Auto in Form von 3D-Skelettmodellen erfasst. Das System ist dann in er Lage, Körperpositionen inklusive Handhaltungen und Blickrichtungen auszuwerten und Schlüsse daraus zu ziehen. Dabei sei es dem System möglich, zu unterscheiden, ob die Fahrerin oder der Fahrer einzuschläft, vom Smartphone abgelenkt ist, der Beifahrerin oder dem Beifahrer etwas zeigt oder telefoniert. „Das kann nicht nur die Interaktion zwischen Mensch und Computer beim Fahrprozess sicherer gestalten“, sagt Manuel Martin, Senior Scientist am Fraunhofer IOSB. „Es ermöglicht auch eine Vielzahl weiterer Anwendungen, zum Beispiel adaptive, also auf die Körperhaltung ausgerichtete Airbag-Auslösung und mehr Komfort, etwa eine intuitive Steuerung über Gesten.“ Praktisch: Das System ist nicht nur für einen Einsatz beim autonomen Fahren geeignet, sondern überall dort, wo es um die Interaktion von Mensch und Maschine geht, zum Beispiel bei Robotereinsätzen in der Montage und Pflege oder in intelligenten Operationssälen.

Mehr zum Thema autonomes Fahren:

- Autonom fahrender Maserati nimmt an der Mille Miglia 2023 teil

- Selbständige und präzise Navigation durch das Lager

- Autonome Roboter für den Mond

Ein Beitrag von: