Generative KI boomt – doch Sicherheitsrisiken wachsen mit

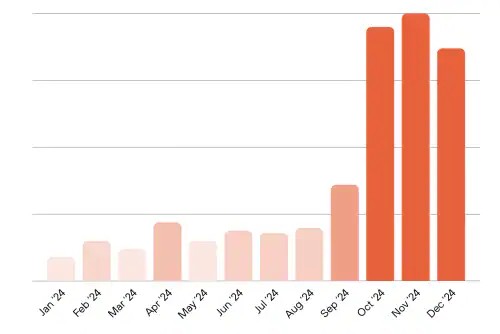

Generative künstliche Intelligenz (Generative Artificial Intelligence, GenAI) ist im Jahr 2025 keine experimentelle Technologie mehr, sondern eine unternehmenskritische Lösung, die Unternehmen unterstützt, innovativ zu arbeiten und Daten zu schützen. Zwar ermöglicht GenAI beispiellose Produktivitätssteigerungen, gleichzeitig führt sie zu neuen, komplexen Risiken: Während der GenAI-Traffic 2024 um über 890 Prozent gestiegen ist, haben sich sicherheitsrelevante Vorfälle um das 2,5-Fache erhöht.

Generative künstliche Intelligenz ist im Jahr 2025 eine unternehmenskritische Lösung, die Unternehmen unterstützt, innovativ zu arbeiten und Daten zu schützen.

Foto: PantherMedia / biancoblue

Die neue Studie „The State of Generative AI Report“ von Palo Alto Networks auf Basis von Daten aus über 7.000 Kundenumgebungen weltweit zeigt die wichtigsten Erkenntnisse im Überblick:

- Die Zahl der GenAI-bezogenen Data-Loss-Prevention-Vorfälle (DLP) hat sich im Jahr 2025 im Vergleich zum Vorjahr um das 2,5-Fache erhöht – sie machen nun 14 Prozent aller DLP-Vorfälle aus.

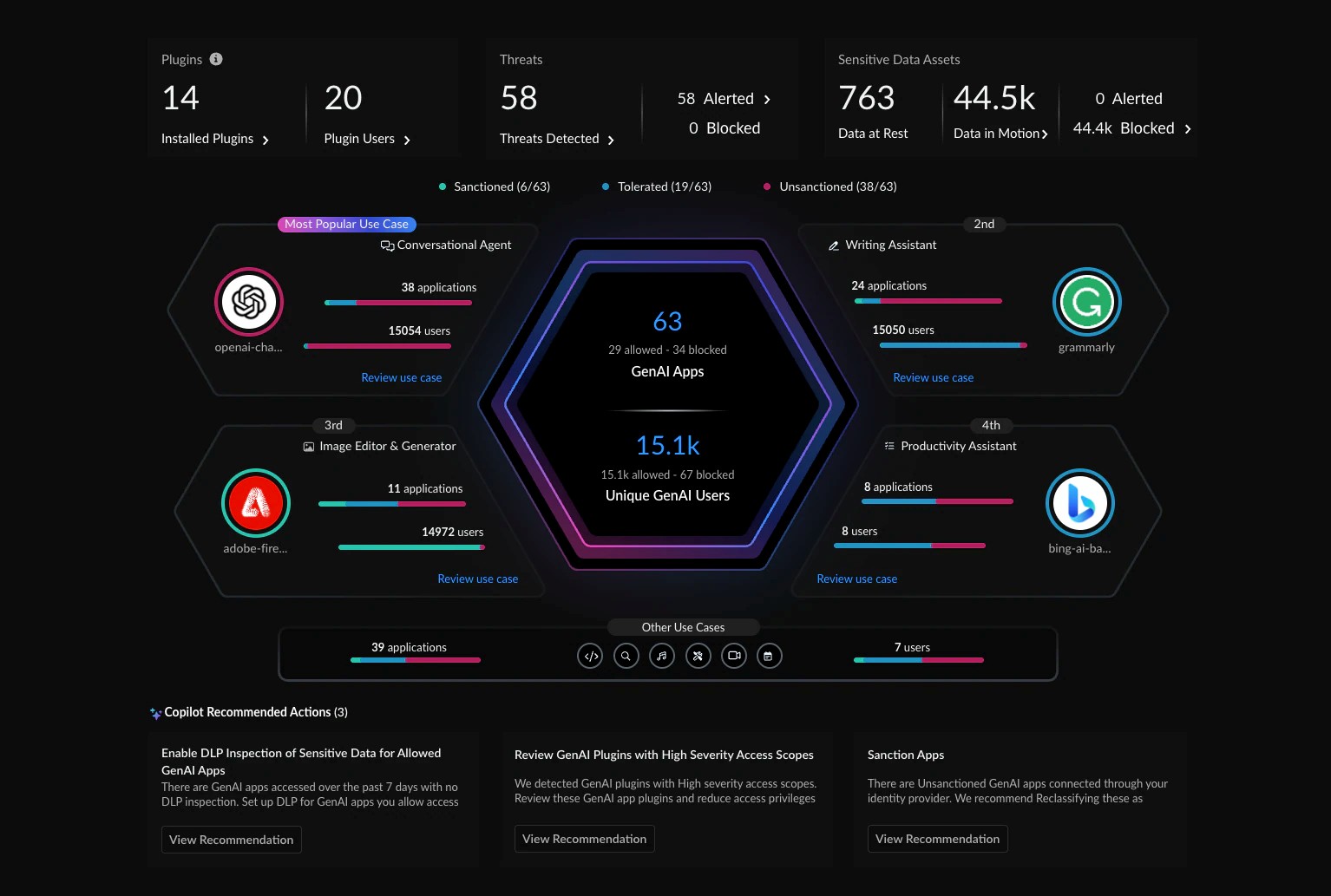

- Unternehmen nutzen im Schnitt 66 verschiedene GenAI-Anwendungen – rund zehn Prozent davon gelten als hochriskant.

- Über 70 Prozent der getesteten GenAI-Apps zeigten bei Sicherheitstests problematische Inhalte – von diskriminierenden Aussagen bis hin zu Bauanleitungen für Waffen.

- Die Technologie- und Fertigungs-Sektoren treiben den Einsatz von Coding-Plattformen besonders stark voran – allein 39 Prozent aller GenAI-Coding-Transaktionen stammen aus diesen Branchen.

- GenAI-Spitzenreiter ist DeepSeek-R1 mit einem Wachstum von 1.800 Prozent nach seinem Launch im Januar 2025.

- Shadow AI – also nicht genehmigte GenAI-Nutzung durch Mitarbeitende – ist eine der größten Sicherheitsbedrohungen. Unternehmen registrieren im Schnitt über sechs besonders riskante GenAI-Anwendungen in ihrer Infrastruktur.

Starker Anstieg im Einsatz generativer KI

Auch in Deutschland, Österreich und der Schweiz zeigt sich ein starker Anstieg beim Einsatz generativer KI, mit regionalen Unterschieden: In Deutschland führt Microsoft Power Apps mit 24 Prozent des GenAI-Traffics, gefolgt von Grammarly (21 Prozent) und ChatGPT (20 Prozent). In der Schweiz dominiert Power Apps mit 33 Prozent, MS Office365 Copilot folgt mit 25 Prozent, ChatGPT mit 17 Prozent. In Österreich liegt Grammarly mit 33 Prozent vorne, gefolgt von ChatGPT (25 Prozent) und Power Apps (22 Prozent).

Hohes Risiko für Datenlecks und Regelverstöße

Gleichzeitig werden in deutschen Unternehmensnetzwerken vermehrt Anwendungen genutzt, die ein besonders hohes Risiko für Datenlecks und Regelverstöße bergen. Der KI-basierte Interviewer Micro 1 AI macht fast 49 Prozent des risikobehafteten GenAI-Traffics in Deutschland aus. Auch UseChat (etwa 32 Prozent) und Zendesk AI (rund 29 Prozent) gehören zu den sicherheitskritischen Tools.

Klare Richtlinien zur Einführung technischer Schutzmechanismen fehlen

„Die Studienergebnisse offenbaren ein fundamentales Dilemma: Die Einführung von GenAI erfolgt oft schneller als deren sichere Integration. Ohne klare Richtlinien, technische Schutzmechanismen und kontinuierliche Überwachung riskieren Unternehmen nicht nur den Verlust sensibler Daten, sondern auch regulatorische Konsequenzen und Imageschäden. Für eine sichere Nutzung empfiehlt Palo Alto Networks unter anderem Zero-Trust-Architekturen, granulare Zugriffskontrollen und Echtzeit-Content-Scanning, um Sicherheitsrisiken frühzeitig zu erkennen und abzuwehren. Entscheidend ist es, Innovation und Schutz nicht als Widerspruch, sondern als gemeinsames Ziel zu verstehen“, so Martin Zeitler, Senior Director Technical Solutions bei Palo Alto Networks.